公開日 /-create_datetime-/

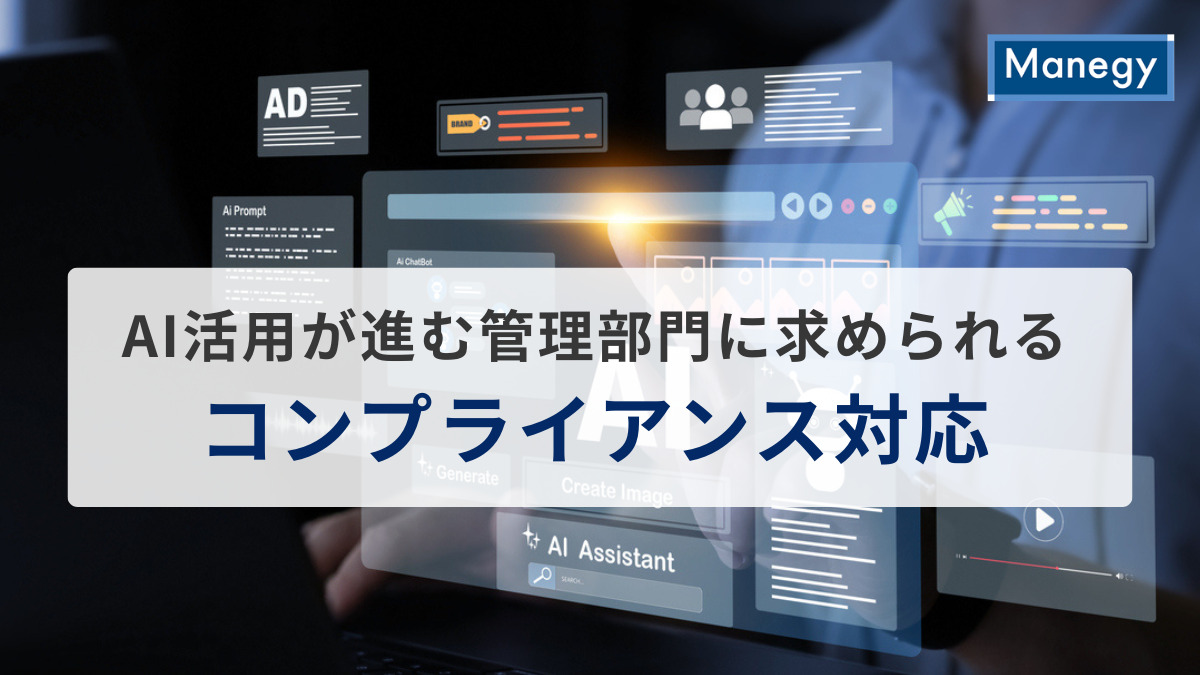

AI活用が進む管理部門に求められるコンプライアンス対応とは― 技術革新と倫理的ガバナンスの両立に向けて ―

AI(人工知能)の進化は、企業の業務プロセスに革命をもたらしています。中でも、人事・総務・経理といった管理部門では、業務の効率化や意思決定の高度化を目的に、AI技術の導入が加速度的に進んでいます。

しかし、AIは単なる業務効率化ツールにとどまらず、活用のあり方によっては企業の信頼やコンプライアンスに直結するリスクもはらんでいます。本記事では、管理部門におけるAI活用の現状と、それに伴う法的・倫理的課題、そして今後求められるガバナンス体制について解説します。

目次本記事の内容

▼この記事を書いた人

松葉 治朗

jinjer株式会社

CPO / ジンジャー人事DX総研 所長

2014年に新卒入社したベンチャー企業で、新規事業の企画、営業、管理など幅広い業務に従事。

2015年9月に大手人材企業に転職し、クラウド型人事労務システム「ジンジャー」の立ち上げに参画。

現在は最高プロダクト責任者として、統合型データベースを軸としたHRコンパウンドサービスのプロダクト戦略の立案と実行を行いながら、ジンジャー人事DX総研(旧:jinjer HR Tech総研)の所長として、人事DXに関する様々な発信をおこなっている。

1.管理部門にも広がるAI活用の波

これまでAIといえば、製造業やマーケティング領域での活用が注目されてきましたが、最近では人事労務、経費精算、契約書管理に至るまで、管理部門の定型業務にもAIの活用が進んでいます。

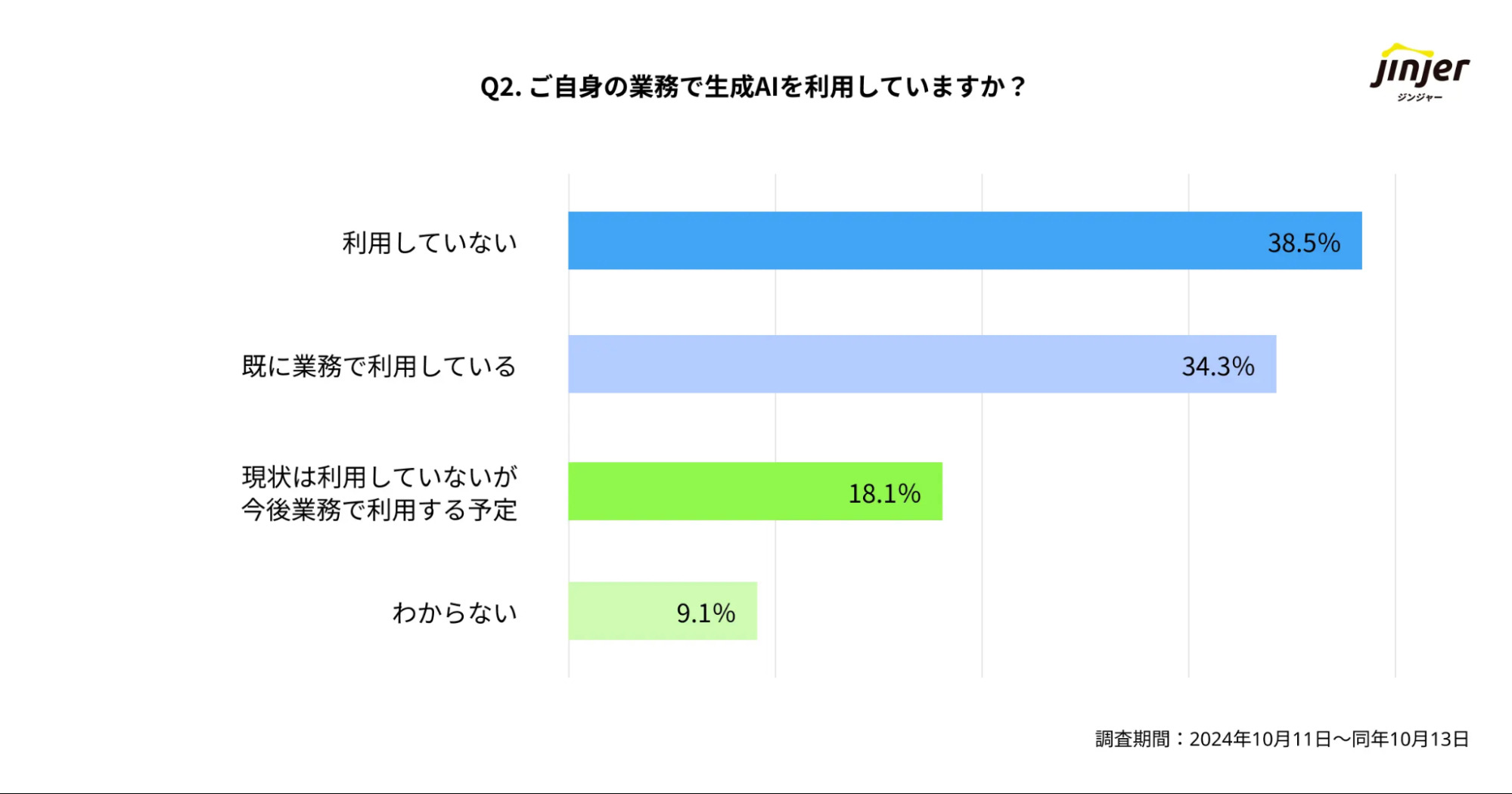

たとえば、弊社が公開した調査(※1)では、企業の約34%が「人事労務業務においてAIを利用している」と回答しました。

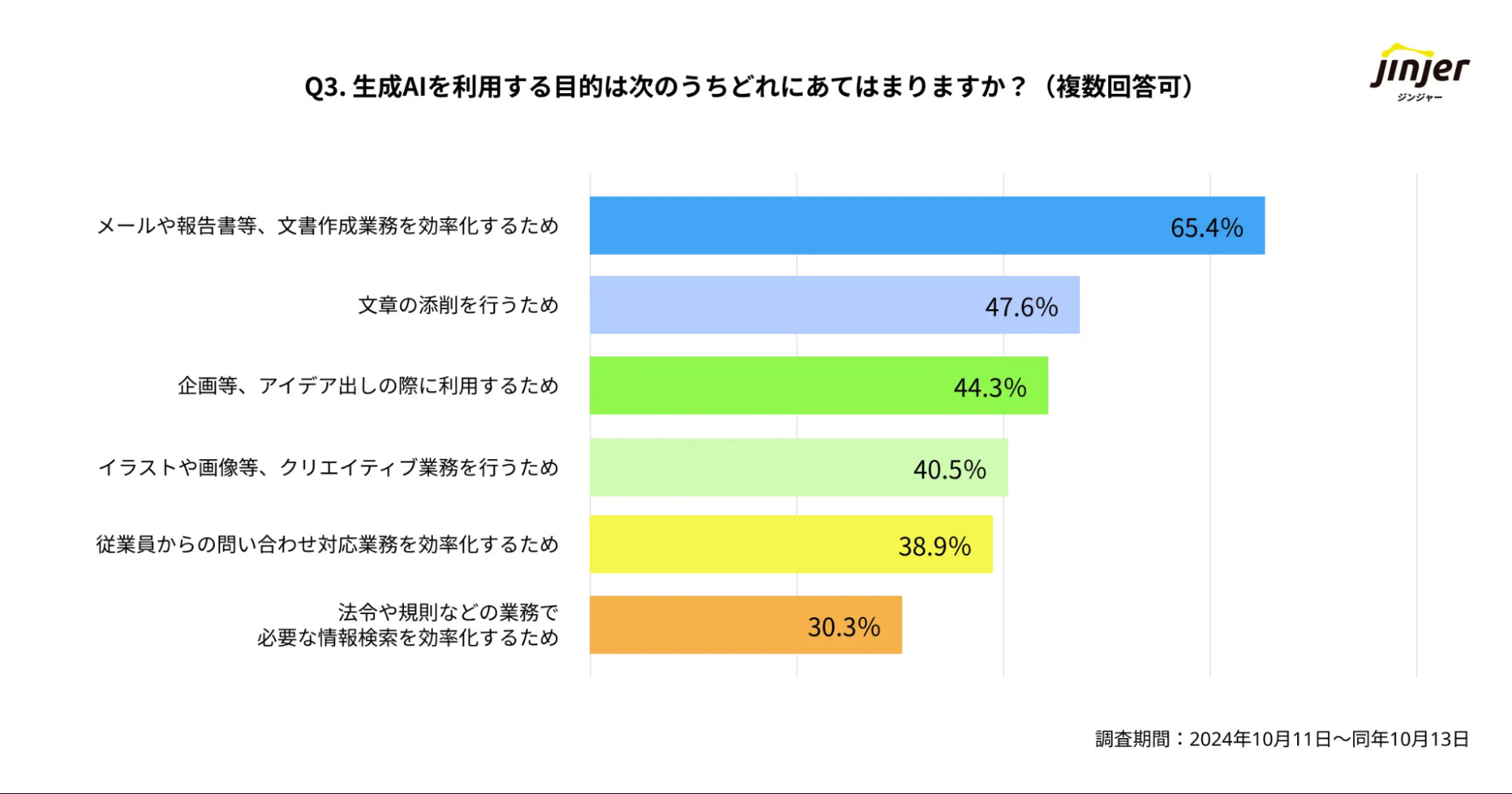

また、AIを利用する目的としては「メールや報告書など文書作成業務の効率化」「文章の添削」「企画時のアイデア出し」など、多岐にわたる用途が挙げられました。

これにより、時間のかかる作業の自動化や、人の手では困難だった大量データの解析が可能になります。特に、離職予測やエンゲージメント分析、ダイバーシティ評価といった「予測型の意思決定」が求められる領域において、大きな効果が期待されています。

これまで属人化しがちだった業務や定型業務も、より迅速かつ精度高く実行できるようになっていると言えるでしょう。

lockこの記事は会員限定記事です(残り1906文字)

会員の方はログインして続きをお読みいただけます。新規登録するとManegy内で使える1,600ポイントをプレゼント!またログインして記事を読んだり、アンケートに応えたりするとポイントが貯まって、豪華景品と交換できます!

※本記事は一般的な情報提供を目的としており、最新情報や具体的対応は公式情報や専門家にご確認ください。詳細はご利用規約をご覧ください。

おすすめコンテンツ

新着おすすめセミナー

人気記事ランキング

キャリア記事ランキング

新着動画

関連情報

-

新卒エンジニア採用に20年投資し続けてわかったこと~代表取締役が語る新卒採用の重要性~

おすすめ資料 -

消費者契約法で無効にならないキャンセルポリシーの作成方法

おすすめ資料 -

今からでも間に合う! 中小企業にお勧めな電子帳簿保存対応

おすすめ資料 -

新卒エンジニア採用施策アイデア大全

おすすめ資料 -

社員と会社の両方が幸せになる生活サポートとは?

おすすめ資料 -

2025年「早期・希望退職募集」は 1万7,875人 、リーマン・ショック以降で3番目の高水準に

ニュース -

決算整理仕訳とは?仕訳例でわかる基本と実務の注意点

ニュース -

消費税の特定課税仕入れとは?仕入税額控除の際の注意点

ニュース -

研究開発費及びソフトウェアの会計処理 第5回(最終回) ソフトウェアと循環取引

ニュース -

2025年上場企業の「不適切会計」開示43社・49件 11年ぶり社数・件数が50社・件を下回る、粉飾は7件

ニュース -

株式会社I-ne導入事例~月間の受注データ件数は20万件以上!『 Victory-ONE【決済管理】』の導入で 業務効率化と属人化の解消を実現~

おすすめ資料 -

健康経営ソリューションとして 社宅・社員寮が果たす役割

おすすめ資料 -

管理部門職種別 面接質問集【MS-Japan】

おすすめ資料 -

株式譲渡契約書とは?記載事項や作成時の注意点について解説!

おすすめ資料 -

英文契約書のリーガルチェックについて

おすすめ資料 -

リバースチャージ方式の会計処理とは?仕訳例や消費税申告の考え方を解説

ニュース -

未払金と未払費用の違いとは?仕訳例を使い経理担当者にわかりやすく解説

ニュース -

消費税仕入税額控除の計算方法2つと、個別対応方式と一括比例配分方式、変更のタイミングを解説

ニュース -

研究開発費及びソフトウェアの会計処理 第4回 ソフトウェアの導入費用の取扱い

ニュース -

管理部門の今を知る一問一答!『働き方と学習に関するアンケート Vol.3』

ニュース